Lo que vamos a tratar en este artículo recuerda lejanamente al escándalo de Volkswagen en 2015. La compañía alemana fue acusada de instalar un software en millones de vehículos diésel para engañar a los reguladores de emisiones. Este software detectaba cuándo el automóvil estaba siendo sometido a pruebas de emisiones en un laboratorio. Durante estas pruebas, el software activaba un modo de funcionamiento que reducía las emisiones de óxidos de nitrógeno para cumplir con los estándares regulatorios.

El caso no nos ha venido a la cabeza sin más: la IA se ha convertido en una prioridad para numerosas industrias, y esto deja el terreno abonado para que aflore la picaresca. Esta tecnología atrae clientes, y quién nos libra de que en pos de la supuesta reducción de costes que conlleva no caigamos en el todo vale.

Es fácil, por ejemplo, prometer una reducción de costes con el uso de IA generativa para crear ciertos productos o servicios; sin embargo, la realidad es que habitualmente, la obtención de resultados no es inmediata. Todos los que la usamos nos hemos enfrentado a un sinfín de pruebas antes de tener un prompt que nos proporcione resultados cercanos a los que necesitamos, y aún así lo más cercano requiere siempre retoques en mayor o menor medida. E incluso cuando por fin tenemos “El Prompt” nos damos cuenta de que con el tiempo los resultados comienzan a alejarse hasta que tenemos que volver a ajustarlo.

Como consecuencia tenemos un reducido grupo de personas que le tendrá que echar muchas horas a la obtención de dichos productos o servicios, ya que la IA generativa no puede, de momento, proporcionar el objetivo con la precisión o la calidad mínima necesaria a la primera.

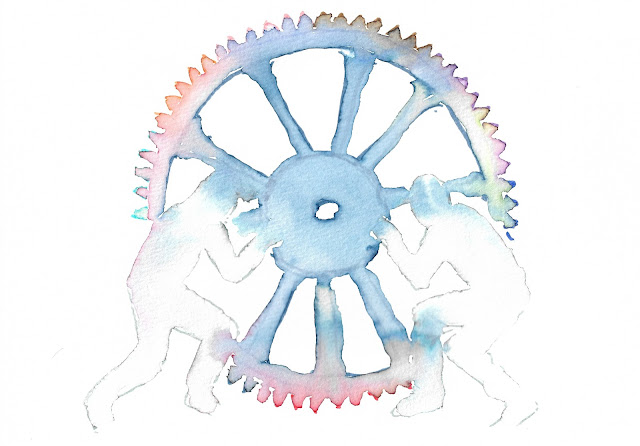

Los trabajadores implicados han de cargar con el sobretrabajo necesario para que los servicios vean la luz, y así poder fidelizar clientes y atraer a otros nuevos. Una vez que el trabajador se convierte en un «experto en IA» se supone que puede propiciar ahorro y eficiencia, pero, ¿es esto real, o para cada caso concreto y ámbito distinto hacen falta N intentos, refinamientos periódicos, y/o retoques en los resultados?

El cliente puede que obtenga lo que necesita, pero no sabe que no solo hay IA tras ello, sino mano de obra humana (en muchos casos, barata o no bien recompensada). Y volvemos a Volkswagen: en este caso, la marca «tropezó» con investigadores independientes que descubrieron el pastel, con repercusiones legales, multas millonarias y daños graves a su reputación. El supuesto que estamos proponiendo aquí es mucho más difícil de demostrar, pero estamos seguros de que ya existe y se propaga por el aire como un germen contagioso.

La promesa de la IA a menudo supera su capacidad real. El uso engañoso de esta tecnología no solo impacta a los empleados directamente involucrados, sino también a las empresas y clientes que están creyendo que es IA todo lo que reluce. Esto genera numerosas preguntas éticas y nos recuerda que hay agentes que intentan mantener un diálogo abierto y honesto con los stakeholders (en el sentido que le da Edward Freeman), y trazar un camino coherente, seguro y sostenible, pero también que los hay que rubrican dichos esfuerzos mientras se esfuerzan en el camino justamente opuesto: nada nuevo bajo el sol.

¿Y si es lo de siempre, a qué viene alarmarse? A que aún no nos hemos dado cuenta de que «es lo de siempre» pero con algo nuevo, algo que tiende a ser nosotros mismos pero infinitamente más poderoso.